在InHand AI边缘计算机上体验 DeepSeek R1 蒸馏模型

春节期间,国产大模型 DeepSeek R1 凭借开源特性和高效推理能力成为 AI 领域的焦点。其知识蒸馏技术能将复杂模型的推理能力迁移至轻量化版本,使其在多项基准测试中表现优异,甚至超越部分国际顶尖模型。开源策略+轻量设计,不仅降低了 AI 部署门槛,更为边缘计算场景带来了全新的可能。

春节后首个工作日,InHand AI 技术团队成功在 EC5000系列边缘计算机上完成 DeepSeek R1 蒸馏模型的本地部署。这一成果验证了轻量级边缘设备(如 EC5000)在 AI 推理任务中的强大潜力。相较于传统云端部署,边缘端计算无需依赖高算力服务器,可在低功耗环境下实现实时推理,为工业质检、智慧交通、远程医疗等领域提供更灵活、安全、高效的AI 解决方案。

通过几个简单的步骤,就可以实现在EC5000系列边缘计算机上运行DeepSeek R1 蒸馏模型。

步骤1:安装Nvidia的jetson containers工具包

通过以下两条命令完成jetson containers工具包的下载和安装:

git clone https://github.com/dusty-nv/jetson-containers

bash jetson-containers/install.sh

步骤2:安装Nvidia Jetpack工具包

通过以下两条命令完成Nvidia Jetpack工具包的下载和安装:

sudo apt update

sudo apt install nvidia-jetpack

步骤3:修改Docker镜像仓库源为中国大陆国内源(非必须)

在目录 /etc/docker/ 下创建文件daemon.json。

在文件daemon.json中输入以下内容并保存(以vim编辑器为例):

sudo vim /etc/docker/daemon.json

{

“registry-mirrors”: [

“https://docker.1ms.run”,

“https://docker.xuanyuan.me”

]

}

保存文件后,通过以下命令重启Docker服务,使配置文件生效

sudo systemctl daemon-reload

sudo systemctl restart docker

注意:

1.https://docker.1ms.run 和https://docker.xuanyuan.me两个docker镜像源地址仅保证在2025年2月5日可用,如果服务器失效,需要将地址修改为当前可用的服务器地址。

2. 此步骤非必须,仅当默认docker仓库地址不可用时,自定义镜像仓库地址用于加速。中国大陆以外的用户,一般不需要执行此步骤。

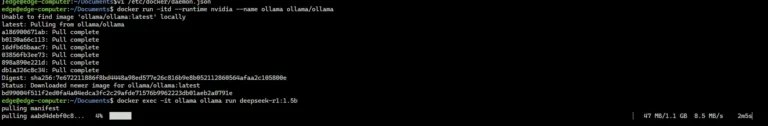

步骤4:下载并运行ollama容器

docker run -itd --runtime nvidia --name ollama ollama/ollama

步骤5:通过ollama 下载并运行deepseek r1的蒸馏模型

参考链接:https://ollama.com/library/deepseek-r1:1.5b

选择要运行的Deepseek R1 蒸馏模型版本,然后通过ollama 命令行自动安装。以DeepSeek-R1-Distill-Qwen-1.5B模型为例,执行下面的命令:

docker exec -it ollama ollama run deepseek-r1:1.5b

其中,参数deepseek-r1:1.5b为模型名,可替换为其它想要运行的模型名称(参考https://ollama.com/search)。命令执行后,系统将自动下载并安装参数指定的模型。

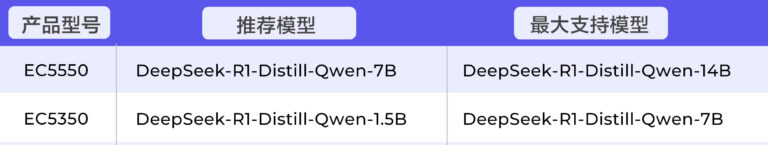

下表列出了EC5000系列边缘计算机支持的DeepSeek R1 蒸馏模型情况:

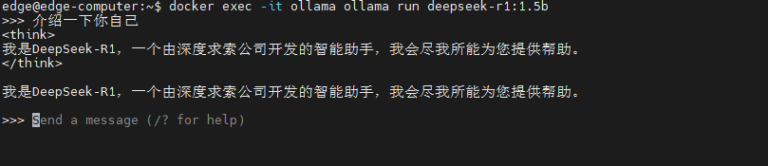

验证模型

执行命令docker exec -it ollama ollama run deepseek-r1:1.5b(deepseek-r1:1.5b 需要替换为用户自己使用的模型名称)后,便可以和模型交互。

其他

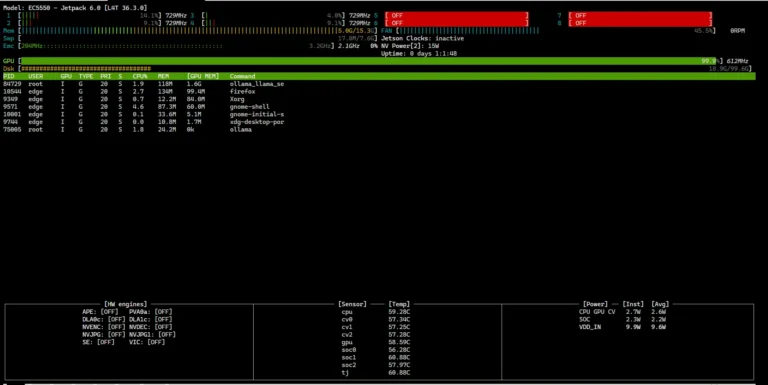

查看EC5000系列边缘计算机的CPU/GPU/内存利用率

设备支持通过jtop命令实时查看本设备硬件状态,执行sudo jtop 后,将会看到下图所示的输出:

注意:jtop命令必须通过root权限执行。

说明

1. 除了示例中的deepseek R1 蒸馏模型外,EC5000系列边缘计算机也支持其它开源的LLM,如llama3等。

2. 通过ollama在EC5000系列边缘计算机中运行LLM方法并不是唯一的。

此次在EC5000系列边缘计算机上成功部署DeepSeek R1蒸馏模型,不仅验证了边缘硬件与前沿AI技术的深度融合能力,更开启了“轻量化+高性能”的边缘AI新范式。

未来,随着蒸馏技术的持续优化,企业可基于此类方案快速构建私有化AI服务,降低算力成本的同时保障数据安全。InHand 将持续推动边缘智能生态建设,助力千行百业迈向“端侧智慧化”的新阶段。