轻量化大模型适配国产平台:DeepSeek R1蒸馏模型在InHand EC3000边缘计算机上的部署实践

随着国产大模型DeepSeek R1在EC5000边缘计算机的成功实践,InHand AI技术团队进一步探索了其在国产计算平台上的部署方法。

本次部署的EC3000系列采用国产瑞芯微RK3588平台,其8核CPU架构(4×Cortex-A76 + 4×Cortex-A55)与6TOPS算力的NPU结合,为轻量化模型推理提供了基础硬件支撑,赋能各类AI应用场景。

在自主可控需求日益迫切的当下,如何在基于国产平台的边缘端实现大模型高效部署,已成为边缘计算领域的重要课题。

通过对模型文件进行格式转换和部署,EC3000系列边缘计算机可以成功运行DeepSeek R1蒸馏模型,并利用其内置的神经网络处理单元(NPU)进行硬件加速推理。

注意:在EC3000系列边缘计算机上通过本文的方法运行.rkllm格式的大模型,需要固件版本不低于V2.0.4。

·模型文件转换

注意:此步骤的所有操作都是在运行linux系统的PC中完成。

·获取模型文件

以DeepSeek-R1-Distill-Qwen-1.5B为例,执行以下命令:

Tips:国内用户可以使用hf-mirror或者modelscope代替huggingface,以获得更快的下载速度。

git lfs install

git clone

.

·下载RKNN-LLM工具包并安装

执行以下命令,下载rknn-llm工具包并安装rkllm-toolkit工具:

git clone

https://github.com/airockchip/rknn-llm.gitcd rknn-llm/rkllm-toolkitpip3 install

rkllm_toolkit-1.1.4-cp310-cp310-linux_x86_64.whl

注意:请根据系统的python版本选择对应的rkllm-toolkit安装文件。

·执行模型文件转换

进入目录

rknn-llm/examples/DeepSeek-R1-Distill-Qwen-1.5B_Demo/export,

使用编辑器打开文件export_rkllm.py,修改变量modelpath的值为存放前面下载的模型文件的路径。保存后,执行以下命令,等待模型文件转换完成即可。

python export_rkllm.py

转换完成后,.rkllm格式的模型文件默认放在export_rkllm.py所在目录。

·模型部署

·将相关文件下载到EC3000设备中

将前面转换后的.rkllm模型文件和rknn-llm/examples/rkllm_server_demo文件夹下载到EC3000设备中。

·运行官方LLM推理服务demo

进入rkllm_server_demo/rkllm_server目录,以DeepSeek-R1-Distill-Qwen-1.5B_W8A8_RK3588.rkllm

模型文件为例,依次执行以下面命令即可

ulimit -n 102400

python flask_server.py –rkllm_model_path /media/ssd/llm/models/DeepSeek-R1-Distill-Qwen-1.5B_W8A8_RK3588.rkllm –target_platform rk3588

注意:/media/ssd/llm/models/DeepSeek-R1-Distill-Qwen-1.5B_W8A8_RK3588.rkllm这个参数需要根据用户自己的模型文件实际存放路径修改。

·验证模型

打开一个新的终端,进入目录rknn-llm/examples/rkllm_server_demo/,执行以下命令:

python chat_api_flask.py

命令执行后,系统将自动启动一个对话框,用户即可与DeepSeek R1蒸馏模型实时对话,如下图所示:

EC3000系列边缘计算机中,实测使用W8A8参数量化构建的DeepSeek-R1-Distill-Qwen-1.5B模型的推理速度高达15.4 tokens/s。

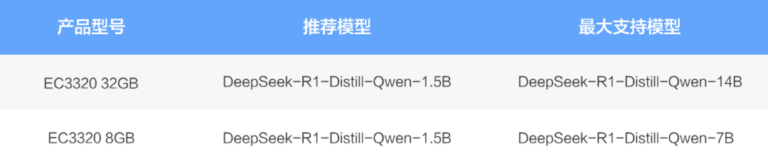

下表列出了EC3000系列边缘计算机对DeepSeek R1蒸馏模型的支持情况:

表中的模型文件,转换时使用的量化参数都是W8A8。

说明

除DeepSeek R1蒸馏模型外,EC3000系列边缘计算机也支持其它开源的大语言模型,运行方法类似。

此次基于EC3000系列完成DeepSeek R1蒸馏模型的本地化部署,初步验证了国产边缘计算平台在轻量化大模型推理场景中的可行性。通过模型量化与硬件架构的针对性适配,我们验证了国产芯片架构(RK3588)在低功耗约束下实现复杂模型推理的技术路径可行性。InHand将持续推进”国产硬件+自主算法”的技术路线,为不同算力层级的边缘设备提供匹配的AI解决方案,与EC5000系列共同构建起覆盖多元场景的智能边缘计算矩阵。